Modélisation du Risque Opérationnel avec des Modèles de Markov Cachés (HMM) et des Variables Macroéconomiques

Source: Selvaratnam, N., Bastide, D., Fernandes, C., & Pieczynski, W. (2026). Modeling dependency between operational risk losses and macroeconomic variables using Hidden Markov Models. arXiv preprint arXiv:2604.21734.

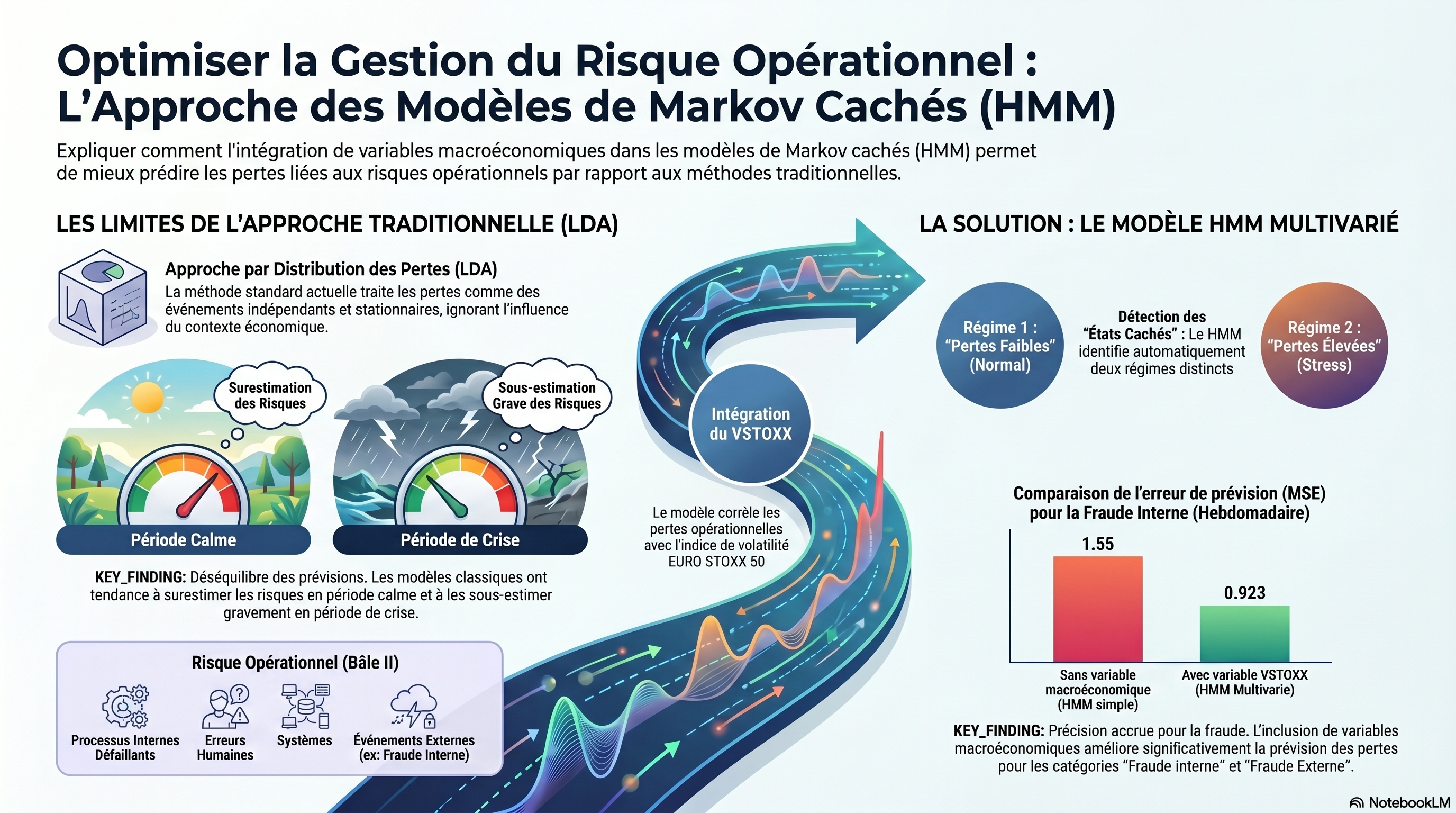

Sommaire: Cet article présente une étude sur la modélisation du risque opérationnel au sein des institutions financières en utilisant des modèles de Markov cachés (HMM). Les auteurs proposent une approche innovante qui intègre des variables macroéconomiques, comme l'indice de volatilité VSTOXX, pour mieux anticiper les pertes liées à des incidents tels que la fraude interne. Contrairement aux méthodes statiques traditionnelles, ce modèle capture les changements de régime et les dépendances temporelles, offrant ainsi une plus grande précision lors des tests de résistance réglementaires. L'efficacité de cette méthode varie selon la catégorie de risque, s'avérant particulièrement pertinente pour les pertes sensibles aux fluctuations des marchés financiers. En combinant l'algorithme Expectation‑Maximization et des vecteurs gaussiens multidimensionnels, l'étude démontre l'intérêt de coupler indicateurs économiques et données historiques pour une gestion proactive du capital.

1. Introduction et Contexte Réglementaire

Le paysage réglementaire de la gestion du risque opérationnel a connu des mutations structurelles profondes. Depuis les accords de Bâle II, l'industrie a évolué de l'approche AMA (Advanced Measurement Approach), qui permettait une grande liberté dans l'usage de modèles internes pour le capital réglementaire, vers une approche standardisée révisée sous Bâle III et Bâle IV. Ce pivot vise à réduire la variabilité injustifiée des actifs pondérés par les risques (RWA) entre les institutions.

Toutefois, la standardisation réglementaire ne signifie pas l'obsolescence de la modélisation avancée. Au contraire, les modèles internes demeurent le pilier de l'évaluation du capital économique et sont indispensables aux exercices de stress‑testing réglementaires tels que le SREP (Supervisory Review and Evaluation Process) et l'ICAAP (Internal Capital Adequacy Assessment Process). La source de référence démontre que les modèles traditionnels de type LDA (Loss Distribution Approach) sont structurellement limités pour ces exercices prospectifs, car ils échouent à capturer la dépendance temporelle et les ruptures de régime.

2. Limites du Cadre LDA Traditionnel et Effets de Clustering

Le modèle standard de l'industrie, le processus de Poisson composé (CPP), repose sur des hypothèses de stationnarité et d'indépendance souvent déconnectées de la réalité empirique :

- Absence de mémoire (Memoryless property) : L'intensité de survenance est supposée constante, ignorant que la résolution d'une panne IT ou d'une faille de contrôle peut réduire la probabilité de récurrence immédiate.

- Stationnarité des intensités : Le CPP ne rend pas compte de la saisonnalité ou des cycles économiques, menant à un phénomène de clustering (regroupement des pertes) lors des crises.

Pour un gestionnaire de risques, la stationnarité est un piège statistique : elle conduit mécaniquement à une surestimation du risque en période calme (par lissage des crises passées) et à une sous‑estimation critique en période de stress, où les pertes s'intensifient de manière non linéaire. Le HMM permet de réconcilier ces motifs non markoviens avec la tractabilité des modèles markoviens.

3. Architecture du Modèle : HMM Multivarié et Défis Algorithmiques

Le modèle proposé par Selvaratnam et al. (2025) utilise un HMM multivarié pour capturer la dynamique jointe des pertes et de l'environnement économique. L'architecture repose sur :

- États Latents (Xn) : Une chaîne de Markov homogène à temps discret représentant des régimes inobservables (ex: "Normal" vs "Stress"). Le choix du nombre d'états K (généralement entre 2 et 6) est arbitré par les critères d'information AIC (Akaike) et BIC (Bayesian).

- Observations (Yn) : Un vecteur gaussien bivarié où la première composante (Y¹ₙ) est la covariable macroéconomique et la seconde (Y²ₙ) la perte opérationnelle. Cette structure permet de modéliser directement la covariance entre les marchés et les pertes via l'état latent.

La mise en œuvre d'un tel modèle impose de résoudre trois défis algorithmiques majeurs, pour lesquels des ajustements techniques sont cruciaux pour un expert :

- Inférence (Forward) : Utilisation de l'algorithme Forward pour calculer la probabilité filtrée (filtered posterior), permettant la prédiction en temps réel. Pour garantir la stabilité numérique et éviter l'underflow (valeurs tendant vers zéro), une procédure de mise à l'échelle (scaling factor sₙ) est appliquée à chaque itération.

- Décodage (Viterbi) : Identification de la séquence d'états la plus probable.

- Apprentissage (Baum‑Welch/EM) : Estimation des paramètres par maximum de vraisemblance. Contrairement à l'inférence, cet algorithme utilise la probabilité lissée (smoothed posterior), intégrant les informations passées et futures (Forward‑Backward). Pour éviter les optima locaux, les paramètres d'émission sont initialisés via une classification K‑means sur les observations.

4. Intégration du VSTOXX comme Indicateur de Stress

L'originalité du modèle réside dans l'utilisation du VSTOXX (volatilité de l'EURO STOXX 50) comme variable auxiliaire. Le VSTOXX n'est pas considéré comme un moteur direct des pertes, mais comme un proxy du sentiment des investisseurs et de l'incertitude systémique. Dans le cadre HMM, il sert de signal stabilisateur : il aide le modèle à identifier les "switchs" de régime latents lorsque les données de pertes, intrinsèquement bruitées, ne suffisent pas à confirmer une transition vers un état de stress.

5. Analyse Empirique : Impact de l'Agrégation et Analogie de l'Image

L'étude se concentre sur la Fraude Interne (ET1), catégorie historiquement corrélée aux cycles financiers (ex: fraudes révélées lors de la crise de 2007‑2009). L'apport de la covariable macroéconomique varie selon la fréquence temporelle des données, un phénomène que les auteurs comparent à la segmentation d'image :

- Haute Fréquence (Hebdomadaire) : Correspond à une haute résolution de pixels. Le détail est maximal mais le bruit est omniprésent. Ici, le VSTOXX est indispensable pour stabiliser l'inférence et distinguer les micro‑fluctuations des véritables changements de régime.

- Basse Fréquence (Trimestrielle) : Les données sont naturellement lissées, comme une image à faible résolution identifiant de larges régions. La persistance des régimes est plus évidente, rendant l'apport du VSTOXX moins critique, bien que toujours statistiquement bénéfique.

6. Performance Prédictive et Back‑testing (VaR 90)

La validation repose sur le back‑testing des dépassements du quantile 90% (VaR 90). Le tableau ci‑dessous, tiré de la Table 3 de la source, compare l'erreur quadratique moyenne (MSE) des dépassements pour la catégorie ET1.

Modèle | Agrégation Trimestrielle (Excl / Incl VSTOXX) | Agrégation Mensuelle (Excl / Incl VSTOXX) | Agrégation Hebdomadaire (Excl / Incl VSTOXX) |

2 États | 4.27 / 3.77 | 2.86 / 1.84 | 1.55 / 0.923 |

3 États | 6.77 / 3.94 | 2.88 / 2.01 | 1.13 / 0.887 |

4 États | 2.59 / 3.06 | 2.43 / 2.26 | 0.982 / 0.859 |

Note : Le MSE est calculé exclusivement sur les "exceedances" (dépassements), conformément à la méthodologie de back‑testing des modèles de queue de distribution. L'inclusion du VSTOXX améliore la précision dans presque toutes les configurations à 2 et 3 états.

7. Hétérogénéité des Risques par Catégories de Bâle

L'efficacité du modèle HMM‑Macro est dépendante de la nature des facteurs déclencheurs de chaque catégorie d'événement (Event Type) :

- ET1 (Fraude Interne) & ET2 (Fraude Externe) : Excellente performance. Ces risques présentent une dépendance statistique marquée vis‑à‑vis de l'environnement macro‑financier.

- ET5 (Dommages aux actifs physiques) & ET6 (Pannes de systèmes) : L'apport du VSTOXX est négligeable, voire contre‑productif. Ces risques sont pilotés par des facteurs opérationnels, technologiques ou environnementaux (ex: catastrophes naturelles, obsolescence IT) pour lesquels la volatilité boursière n'est pas un prédicteur pertinent.

- ET3 (Pratiques d'emploi) & ET4 (Clients, produits et pratiques commerciales) : L'étude ne détecte aucun changement de régime visible, suggérant que ces séries sont mieux modélisées par des structures stationnaires classiques dans le jeu de données testé.

8. Conclusion et Perspectives de Modélisation

L'apport des modèles HMM multivariés réside dans leur capacité à capturer le risque de queue (tail risk) de manière dynamique, offrant une flexibilité supérieure aux modèles LDA statiques pour les scénarios de stress‑test. La capacité du modèle à « apprendre » les transitions de régime via des variables macroéconomiques permet une gestion proactive du capital économique.

Les futures itérations de ces modèles devraient explorer :

- L'usage de distributions à queues épaisses (type Student‑t) pour mieux refléter la sévérité extrême des pertes opérationnelles.

- La sélection de covariables spécifiques : indicateurs climatiques pour l'ET5 ou indices de cyberrisque pour l'ET6.

- L'extension vers des modèles de mélange de gaussiennes (GMM) pour capturer des densités d'émission plus complexes.