Évaluation du cyberrisque dans le secteur financier : Confrontation des approches qualitatives et quantitatives

Source : Crotty, J., & Daniel, E. (2026). Cyber threat: its origins and consequence and the use of qualitative and quantitative methods in cyber risk assessment. Applied Computing and Informatics, 22(1/2), 198–209

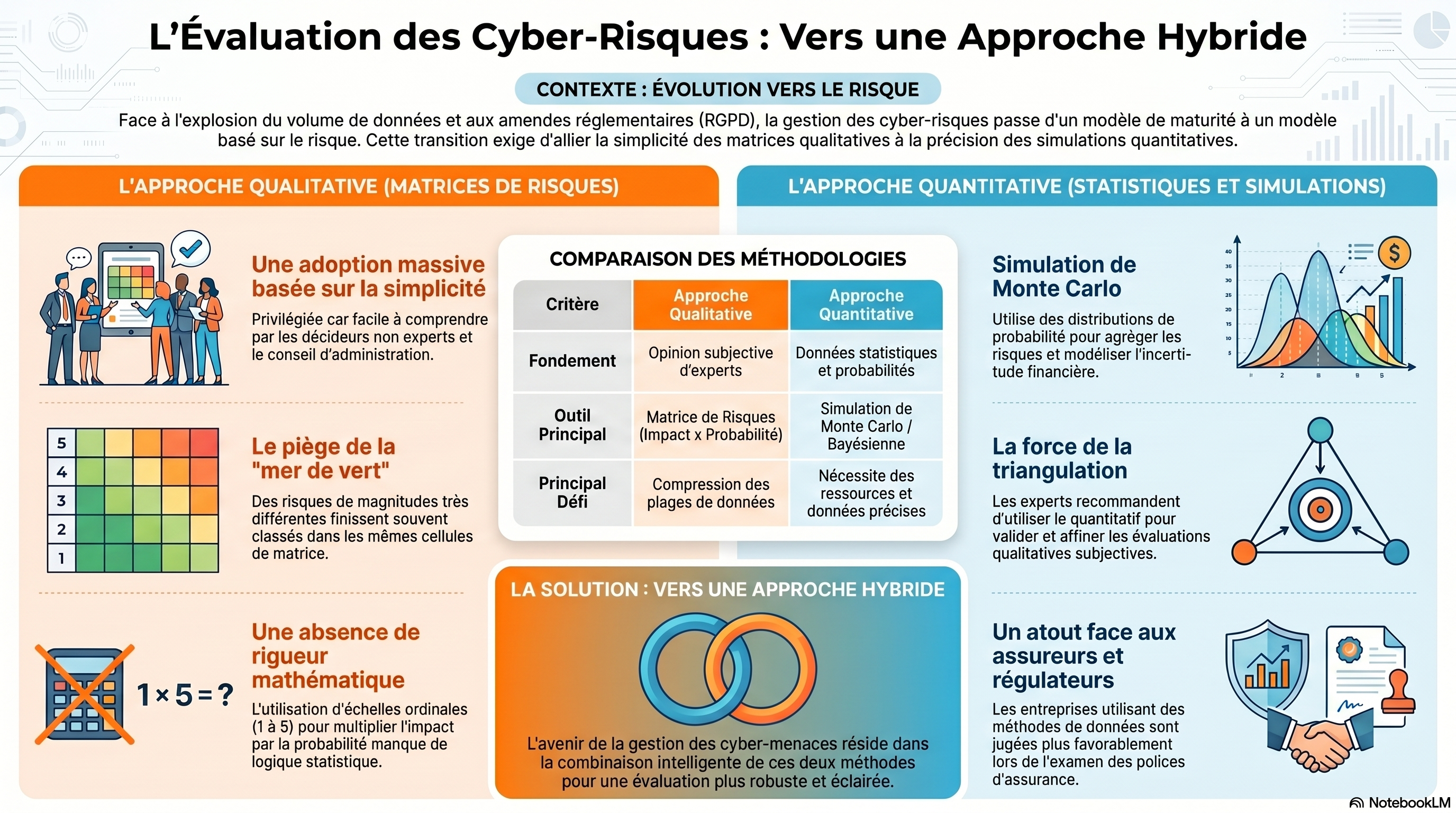

Sommaire : Cet article examine l'évolution des méthodes d'évaluation des risques cyber face à l'augmentation massive des données numériques et des menaces criminelles. L'étude souligne que, bien que les approches qualitatives basées sur des matrices de risques soient simples et largement adoptées, elles manquent de rigueur mathématique et de précision. Pour pallier ces faiblesses, les auteurs explorent l'utilité des méthodes quantitatives, telles que les simulations de Monte Carlo, qui offrent une analyse plus fine malgré une complexité technique accrue. À travers des entretiens avec des experts du secteur financier, l'article démontre que les professionnels privilégient désormais une approche hybride combinant les deux modèles. Cette stratégie permet de mieux répondre aux exigences croissantes des régulateurs et des assureurs tout en optimisant la protection des actifs stratégiques. En conclusion, les sources recommandent une triangulation des méthodes pour obtenir une vision plus réaliste et exploitable des vulnérabilités informatiques actuelles.

1. Introduction et mise en contexte réglementaire

L'étude de James Crotty et Elizabeth Daniel, 2026 (Faculty of Business and Law at The Open University, UK) souligne une mutation structurelle de la valeur : alors que les actifs numériques ne représentaient que 25 % de la capacité de stockage mondiale à la fin du XXe siècle, ils franchissaient le seuil des 90 % dès 2010. Plus significatif encore pour l'analyse des risques, la localisation de ces données a basculé : en 2010, 70 % des données mondiales étaient stockées sur des terminaux personnels (endpoints) ; aujourd'hui, cette proportion a chuté au profit des actifs d'entreprise, faisant des organisations les dépositaires centraux de la valeur numérique mondiale.

Dans ce contexte, la menace s'est professionnalisée. Les cybercriminels sont désormais responsables de plus de 80 % des incidents constatés. Face à cette hégémonie du crime organisé, les régulateurs ont durci leur réponse via le Règlement Général sur la Protection des Données (RGPD), imposant des sanctions exemplaires à des acteurs comme H&M (35 M€) ou British Airways (22 M€). Parallèlement, le marché de l'assurance cyber subit une correction majeure : l'Association of British Insurers (ABI) rapporte des hausses de primes moyennes de 32 %, certains renouvellements atteignant 75 % d'augmentation pour des garanties souvent restreintes.

2. L'hégémonie du qualitatif et ses failles méthodologiques

Malgré la sophistication des attaques, la gestion du risque cyber reste dominée par une inertie méthodologique. L'usage généralisé des matrices de risques s'explique moins par leur efficacité intrinsèque que par leur promotion au sein de standards de facto comme l'ISO 31000 et par l'absence historique de données fréquentistes fiables. En tant qu'analyste, il convient de souligner les limites critiques identifiées par Crotty et Daniel :

- La « compression de plage » (range compression) : En agrégeant des probabilités et des impacts dans des catégories discrètes, les matrices ignorent les « lignes d'iso‑risque » (hyperboles) qui traversent naturellement les cellules. Cela conduit à traiter de manière identique des risques dont la magnitude réelle diverge pourtant de façon significative.

- L'incohérence arithmétique : L'application d'opérations mathématiques (comme la multiplication) à des échelles ordinales est une aberration logique. Les points sur une échelle ordinale ne possédant pas de distance mathématique constante, le score résultant n'a aucune validité statistique.

- L'effet « mer de vert » : La simplification visuelle par codes couleurs génère une illusion de maîtrise qui masque les exceptions critiques aux politiques de sécurité. Cette perception tronquée décourage le débat analytique et instaure un sentiment de confiance injustifié au sein des instances de direction.

3. L'approche quantitative : Apports et défis de mise en œuvre

Pour répondre aux exigences de précision, notamment en matière d'allocation de capital (en résonance avec les cadres de type Bâle III/IV), les méthodes bayésiennes et les simulations de Monte‑Carlo (MCS) émergent comme des alternatives indispensables. En modélisant des distributions de probabilités plutôt que des points fixes, la MCS permet d'agréger l'exposition financière globale face à une multitude d'événements.

Toutefois, des impediments subsistent pour opérationnaliser ces modèles. La volatilité des méthodes d'attaque et la sous‑déclaration chronique des incidents rendent les données historiques souvent obsolètes. Par conséquent, la rigueur mathématique apparente peut paradoxalement induire un nouveau biais de « confiance injustifiée » si l'on oublie que les données d'entrée (a priori) restent largement dépendantes de la subjectivité des experts. Le défi n'est donc pas seulement technologique, mais réside dans la capacité à quantifier l'incertitude elle‑même.

4. Retours d'expérience du secteur financier (CISO & CRO)

Les défis mathématiques mentionnés précédemment sont au cœur des préoccupations des 16 praticiens seniors (CISO, CRO) interrogés. Leurs témoignages révèlent une tension constante entre la nécessité de communiquer simplement et l'exigence de rigueur financière.

Aspect | Méthode Qualitative (Matrices) | Méthode Quantitative (Bayésien/MCS) |

Avantages perçus | Fournit un langage partagé avec le Conseil d'administration. | Permet une allocation précise du capital risque. |

Limites identifiées | Masquage des risques critiques (angle mort). | Manque de données historiques structurées. |

Tendance future | Maintien comme outil de filtrage initial. | Généralisation pour le pilotage financier des risques. |

5. Recommandations : Vers une stratégie de triangulation

L'apport majeur de l'étude de Crotty et Daniel est de proposer une résolution au défi épistémologique - le passage de l'opinion subjective à la validation rigoureuse - par la « triangulation ». Plutôt que d'opposer les méthodes, les auteurs suggèrent un processus hybride structuré :

- Filtrage par matrice de risques : Utiliser la matrice pour une première segmentation (risques à accepter, éviter ou mitiger), en acceptant ses limites pour les risques de faible intensité.

- Modélisation par Diagrammes de Probabilité/Conséquence (PCD) : Pour les risques prioritaires, les auteurs recommandent l'usage de PCD intégrant des « boîtes d'incertitude ». Le centre représente la valeur attendue et les bords illustrent les intervalles de prédiction. Note : Bien que recommandée par les auteurs, cette technique n'est pas encore pratiquée par les experts financiers interrogés.

- Simulation de Monte‑Carlo : Appliquer la MCS exclusivement aux risques critiques nécessitant une modélisation financière complexe ou une décision d'allocation de capital stratégique.

6. Conclusion sur l'impact sectoriel

La maturité dans la gestion des cyberrisques devient un levier de négociation financière. Selon les praticiens du secteur, l'adoption d'une approche multiméthodes par triangulation est un signal fort envoyé aux marchés. En démontrant une capacité à quantifier scientifiquement ses incertitudes, une organisation améliore son profil de risque lors de la souscription d'assurance cyber. Enfin, cette rigueur méthodologique constitue un gage de bonne foi susceptible d'influencer favorablement la clémence des régulateurs en cas d'incident, prouvant que l'institution a mobilisé les meilleures techniques pour protéger ses actifs et ceux de ses clients.